- 我的订阅

- 科技

我们正处于一个信息大暴发的时代,每天都能产生数以百万计的新闻资讯!

虽然有大数据推荐,但面对海量数据,通过我们的调研发现,在一个小时的时间里,您通常无法真正有效地获取您感兴趣的资讯!

头条新闻资讯订阅,旨在帮助您收集感兴趣的资讯内容,并且在第一时间通知到您。可以有效节约您获取资讯的时间,避免错过一些关键信息。

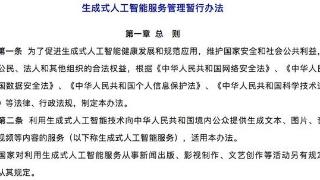

监管AIGC,我们要立怎样的法?

本文转自:上海法治报

□朱福勇

与以往的专家系统或者领域人工智能不同,ChatGPT展现出人工智能不亚于人类的智力水平,用户与之对话,在互动中通过程序创造新内容,激发创造力,产生难以置信的人机交互效果。但巨大红利呼啸而至的同时,普遍性挑战也附随而来。尤其是不当使用内容生成式人工智能(AIGC)可能会进一步加剧社会不公、固化或者扩大偏见与歧视、侵害个人隐私、提供误导性信息、威胁数据安全、人类安全和成为违法活动或不道德行为的工具。如比利时公民皮埃尔因使用ChatGPT诱发自杀,同时还出现类似软件性骚扰用户、泄露用户数据等情形,均引发重大的伦理关切。意大利个人数据保护局认为Chat鄄GPT违反了欧盟《通用数据保护条例》,以国家名义将其禁用。

各国对人工智能的立法监管正如火如荼地展开,今年被认为是人工智能立法监管的元年。尽管不同的国家或法域采取的立法与监管模式不同,但是依循算法治理——深度合成治理——人工智能立法的思路,如何确保人工智能技术安全、有序、规范和可持续向善发展,是一个需要人类共同直面的课题。

早在上个世纪,阿西莫夫提出“三大定律”,已成为人工智能伦理和道德研究中的重要参考,也是立法监管AIGC的重要规范指引。从全方位规范人工智能研发、应用等主体行为以及技术规范与进步平衡的角度出发,相关立法应遵循如下原则:

创新导向原则。鼓励创新,减少对人工智能研发的限制,以创造更多的科技进步机会和空间,推进人类的发展。当然,自由研发并非是恣意妄为,基于国家和社会安全以及人类伦理等因素考量,对于诸如军事、生物技术和可能威胁人类基本权利等敏感领域的人工智能技术研发与应用,则应强化监管力度以保障人类自身的发展和福祉。

合法必要原则。综合考量国家安全,社会稳定,个人权益保护等,注重立法的系统与周延。特别要明确风险规制的目标、规制机关的权力、职责、参与主体的权利义务关系,科技企业的合规监管;对风险防控的具体操作,设定自愿性标准供企业选择;合理平衡各主体间的权益,避免对创新过重苛责。对在既有法律框架下能够解决的风险问题,则无需单独、重复立法。

安全可信原则。为保护人类和环境免受人工智能技术潜在风险的危害,必须确保AIGC技术和系统的安全、可信。即增加人工智能系统的透明度,确保能被理解和解释;需要找到相关责任主体时,能被追踪和追溯;不会造成严重不良影响和危害、不被滥用,提高人工智能设计和运行的安全性;保护用户个人信息和隐私,确保不被非法收集、利用或泄露;避免产生歧视和不公平情形,保证公正平等待遇;确保技术可控,技术成果共享,不被少数人垄断。

风险防范原则。在技术研发、应用场景选择、数据采集和隐私保护等方面,立法设置监督关口,预防潜在的风险和危害,确保技术的安全和可靠性。最大程度从源头降低技术可能带来的风险和危害,同时加强事前风险评估和风险管理,对可能的风险和危害事前预备应对措施,保障技术有序发展。

多主体全领域监管原则。人工智能技术更新迭代迅猛,立法跟不上技术前进的脚步。需要建立一个多元化的监管体系,赋予不同主体监管权力和义务,从不同维度对技术加以规范和引导。政府是主要的监管主体,但不应是唯一的主体,以技术治理技术是较好的监管方式,需要发挥行业自律和企业合规建设的功效,使立法监管更加灵活高效,有效促进和规范技术的不断进步,同时保障公共利益和社会安全。

总体而言,AIGC的技术监管与创新对立而统一。监管在确保技术向着符合人类社会和道德准则方向发展,尽可能减少负面影响,为人类带来更大福祉的同时,还可以促进技术发展和主体间的竞争,推动AIGC技术的进步。受技术发展水平、应用领域和场景、社会影响和公众关注度等因素制约,通常在人工智能技术发展初期,不宜采取过于严苛的监管措施;当技术成熟、市场需求增长、风险和问题日益突出的时候,则应加大监管强度。当前情势下,坚守价值引领与技术“纠错”并行、秩序保障与创新提升协同、权益维护与义务承担对称,无疑是最恰当的平衡之道。(作者系西南政法大学人工智能法学院教授、博导)

以上内容为资讯信息快照,由td.fyun.cc爬虫进行采集并收录,本站未对信息做任何修改,信息内容不代表本站立场。

快照生成时间:2023-04-29 01:45:45

本站信息快照查询为非营利公共服务,如有侵权请联系我们进行删除。

信息原文地址: