- 我的订阅

- 科技

我们正处于一个信息大暴发的时代,每天都能产生数以百万计的新闻资讯!

虽然有大数据推荐,但面对海量数据,通过我们的调研发现,在一个小时的时间里,您通常无法真正有效地获取您感兴趣的资讯!

头条新闻资讯订阅,旨在帮助您收集感兴趣的资讯内容,并且在第一时间通知到您。可以有效节约您获取资讯的时间,避免错过一些关键信息。

免费!免费!免费!GPT-4o是什么?是你想要的一切

距离GPT-4的发布已经过去了一年,当地时间5月13日上午10点,OpenAI春季发布会千呼万唤始出来。

这次发布的既不是传了很久的搜索引擎,也不是GPT5,而是GPT-4的迭代版本,GPT-4o。在未来几周内,用户将会陆续自动更新到GPT-4o。

GPT-4o作为新一代旗舰模型,把AI工具的使用门槛降到了更低的程度,不仅比上一代速度快两倍,能实现无延迟实时对话,而且用户不用注册,功能全部免费。

此外,ChatGPT现在有桌面版本了,轻量化的使用体验可以无缝融入你的任何工作流程,再也不用苦哈哈地往网页上搬砖了。据OpenAI的CTO米拉·穆拉蒂(Mira Murati)表示,这也是他们第一次在易用性上做出改进。

“O”是包罗万象的O

发布会刚开始,米拉·穆拉蒂为这次新发布定了调,说OpenAI的目标是进一步减小人们使用AI的障碍,让所有人都能在工作、学习、创造中用上AI工具。

为了这个目的,OpenAI做了三件事:发布更强大的模型GPT-4o,更新用户界面提高使用体验,然后一口气免费开放给用户。穆拉蒂补充道,付费用户享有五倍的使用容量限制。

米拉·穆拉蒂主持了整场发布会,萨姆·奥尔特曼没有露面|@OpenAI

据OpenAI表示,GPT-4o是一个“原生多模态”模型,它的命名来源于“omni”,即包罗万象之意。

比起此前要么是图文模式要么是语音模式的GPT-4,它更擅长打组合拳,可以接受文字、音频、图像的任意组合输入,然后无缝衔接图文音频的多种形式输出。

升级后的GPT-4o回答速度更快了。

据OpenAI表示,GPT-4想要实现和人的对话需要通过三步来实现:先把语音转换为文字,再生成回复文本,最后再转成语音。根据用户选择模型的不同,这个过程的平均延迟高达2.8秒 (GPT-3.5)和5.4 秒(GPT-4),对着手机屏幕等回复,跟GPT聊过天的朋友应该都有类似的体验。而且在语音转文字再转语音的过程中,很多信息损失了,GPT无法获得说话人的音调,也无法收取背景音,如果有多个人一起说话更是灾难性的场景。

“我们跨文本、视觉和音频端到端地训练了一个新模型,”OpenAI写道,“这意味着所有输入和输出都由同一神经网络处理。”现在的GPT-4o可以在最短232毫秒内响应对话,平均响应时间320毫秒,和人类的反应速度几乎一样,爱跟ChatGPT聊天的朋友终于可以从微信语音模式切换到日常交流模式了。

GPT-4o还带来了更好用的界面。

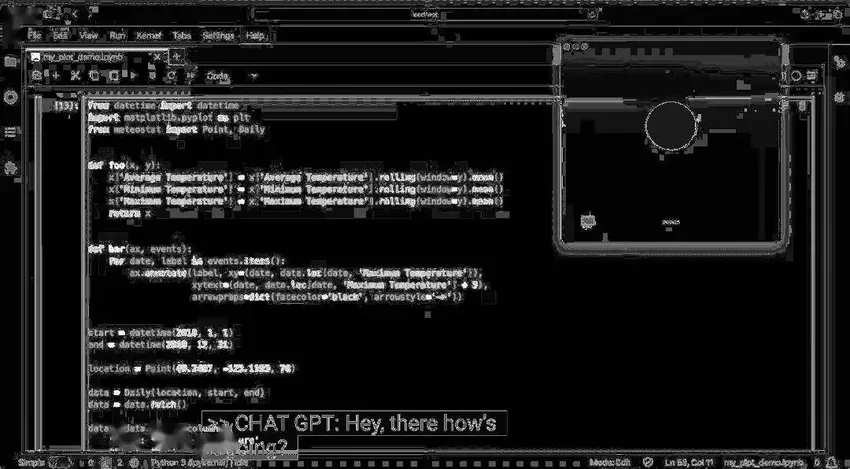

再也不用在网页间互相切换了,新的桌面版GPT可以融入任何工作流,随时和用户用图像文字语音进行交流,虽然还没用上,但可以想像这种工作体验有多快乐。

右上角是桌面版GPT的小窗口,可以贴代码让它debug,可以截图让它读表格,也可以随时跟它对话|@OpenAI

此外,萨姆·奥尔特曼在X上补充道,模型升级不止在GPT上,开发者也可以在API里同步使用GPT-4o,价格是GPT-4 Turbo的一半,速度是GPT-4 Turbo的两倍。GPT-4o还在50多种除英文外的语言能力上得到了加强。

连呼吸都能辨别

发布会的最后一个环节是实机演示。OpenAI麾下的大牛研究员Marc Chen和Barret Zoph一起展示了新模型的强大之处。

在第一段对话里,Chen对GPT说,自己有点紧张,然后开始急促地呼吸。GPT识别到了他呼吸的声音,说,别紧张,你喘得像个吸尘器,深呼吸,再吐气。接着GPT开始指导Chen怎么深吸慢呼平复心情。

这个demo设置得很妙,它展示出了两个重要的新能力:听环境音和即时反馈。

GPT不再需要一轮一轮地进行对话,它可以同时听人喘气和进行呼吸指导,输入和输出在同时发生。

第二个demo里,Chen让GPT给Zoph讲个睡前故事哄他入睡,Chen反复打断GPT的讲述,问它能不能讲得更刺激点,最后,GPT跟迪士尼公主似的把故事用歌唱了出来。

有时候GPT给人感觉话太多了,在新版本里,你要是不想听可以立刻打断或者提出意见,就像在真实生活里的交流一样。

后面的几个demo里,GPT教Zoph做了数学题(“你能不直接告诉我答案,而是启发我一步一步解完嘛?”),给大家解释了代码,读了图表,给Zoph看了面相(“你很开心,又有点激动。”),最后还当了Chen和穆拉蒂之间的同声传译。

GPT给Zoph看面相|OpenAI

我个人的体会是,这个版本的GPT比以前更像人了,对话中会开更多的玩笑,语气词也多了不少,这和OpenAI所说的提高GPT的工具性似乎有点相悖。我可能会在用的过程中让它少废话,否则真的会有点情感压力。

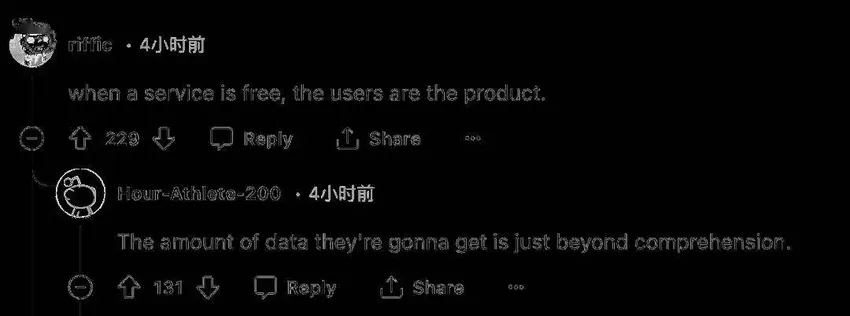

但还是有很多人对这次发布会不满意。有网友觉得OpenAI在挤牙膏,一年多过去了仍然在GPT-4上裹足不前,也有人对免费提出了质疑。

“当服务免费时,用户就是产品。”“(ChatGPT免费之后)OpenAI获得的数据量会超出想象。”

对一般用户来说,不用注册即可使用已经是个天大的惊喜了,再也不用找国外手机号了,懂的都懂。

作者:翻翻

编辑:Odette

封面图来源:OpenAI

如有需要请联系sns@guokr.com

以上内容为资讯信息快照,由td.fyun.cc爬虫进行采集并收录,本站未对信息做任何修改,信息内容不代表本站立场。

快照生成时间:2024-05-14 12:45:28

本站信息快照查询为非营利公共服务,如有侵权请联系我们进行删除。

信息原文地址: