- 我的订阅

- 科技

我们正处于一个信息大暴发的时代,每天都能产生数以百万计的新闻资讯!

虽然有大数据推荐,但面对海量数据,通过我们的调研发现,在一个小时的时间里,您通常无法真正有效地获取您感兴趣的资讯!

头条新闻资讯订阅,旨在帮助您收集感兴趣的资讯内容,并且在第一时间通知到您。可以有效节约您获取资讯的时间,避免错过一些关键信息。

轻量化模型架构catvton的优势在哪里

只需两张图像,不到30秒,就能让马斯克穿牛仔走红毯~

或者让寡姐带货国风Polo衫~

就是二次元换装也不在话下。

来自中山大学、Pixocial等机构联合发布轻量化模型架构CatVTON。他们是以StableDiffusionv1.5inpainitng为基础模型。

来看看更多效果。

用扩散模型进行虚拟试衣

CatVTON可以实现传统平铺服装图到人物的换装。

不管是上衣、裤子、裙子,还是套装,各种不同品类服装都可以。

其形状和纹理都能保持较高的一致性。

另外,CatVTON还可以实现人物A到人物B的换装。

无需显式地指定类别,根据Mask的不同即可完成目标服装的试穿,支持单独的上衣、裤子、裙子或者全身多件服装同时更换。

既然如此,那又是如何实现的呢?

轻量化模型架构

CatVTON在功能上丰富多样,但其模型架构却十分简洁高效:

2个网络模块(VAE+UNet)

899.06M总参数量

<8G推理显存(输出图像1024×768)

轻量化的架构来源于CatVTON对现有方法模块冗余的观察:

基于Warping的方法依靠几何匹配对服装进行形变再利用试穿模块融合,结果生硬不自然;

基于扩散模型的方法引入ReferenceNet,加重了训练和推理的负担;

具体而言,CatVTON通过在输入上把人物、服装在通道维度拼接(Concatenate),在结构上摆脱了对额外的ReferenceNet的依赖,跳过了对图像虚拟试衣来说没有显著帮助的文本交叉注意力,同时也不需要任何额外的图像编码器来辅助生成。

下表详细地比较了不同方法与CatVTON的模块数量、参数量、可训练参数量、显存占用、推理条件。

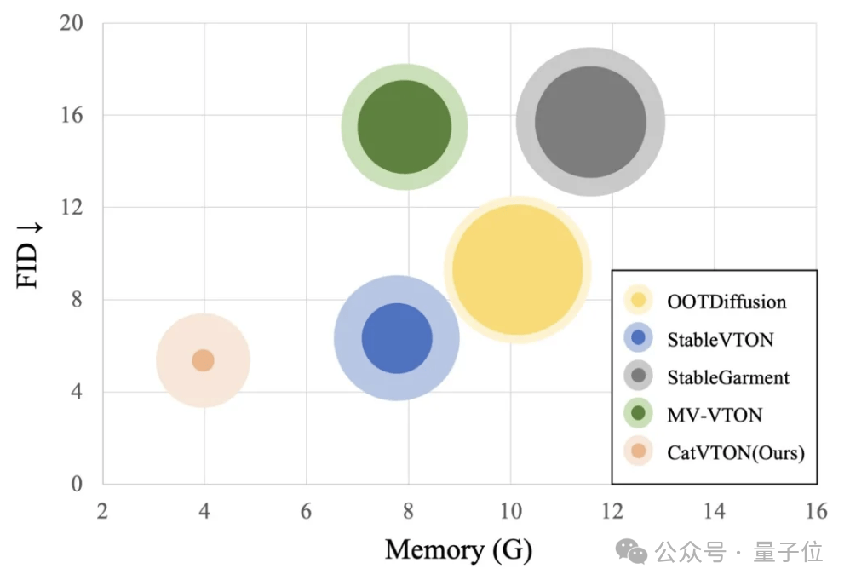

在网络模块上,CatVTON只需要VAE+UNet,无需任何额外的编码器;在模型总参数量上,CatVTON比其他方法至少缩减了44%;在显存占用上,CatVTON也只有其他方法的一半甚至更低,体现了CatVTON在模型架构轻量化上的优势。

△模型高效性相关项详细比较

在训练上,CatVTON探究了在将预训练扩散模型迁移到TryOn任务时去噪UNet中真正起作用的模块。

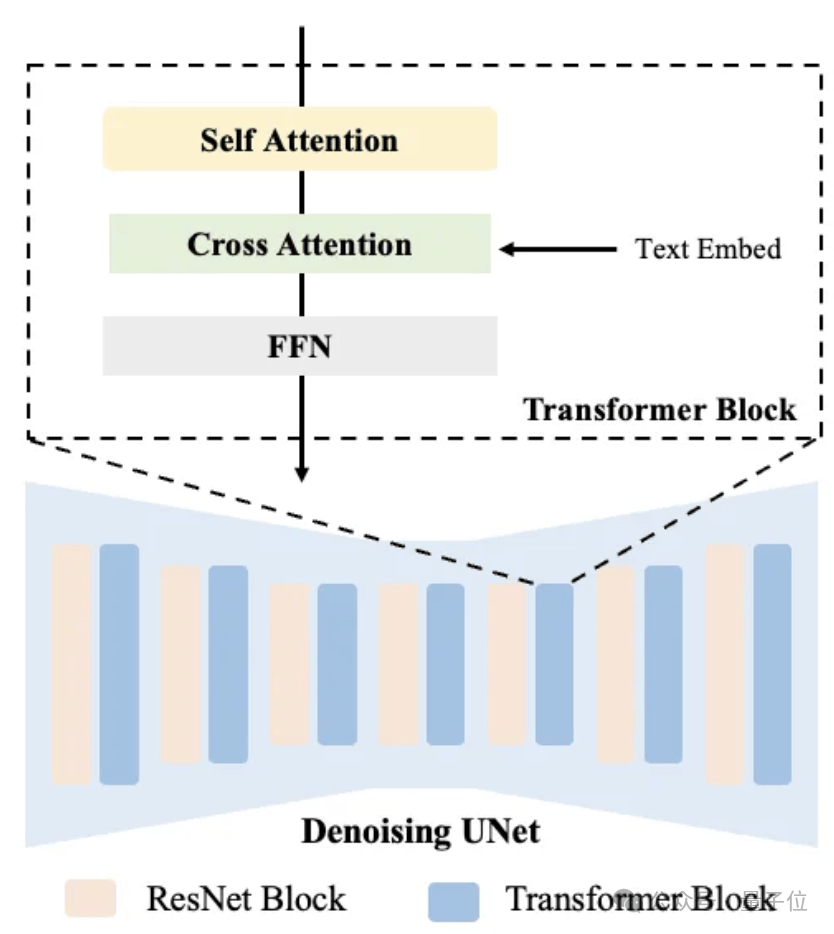

首先,去噪UNet在结构上是由不同特征尺度的ResNet和TransformerBlocks堆叠而成(如下图)。其中ResNet是卷积网络,具有空间不变性,适用于特征的提取,并不负责跨空间的特征交互,这一部分在扩散模型进行大规模预训练时,已经具备了足够的特征编码能力,因此与迁移到TryOn任务关联性不强。

TransformerBlock内部结构又可以细化为三个部分:SelfAttention,CrossAttention和FFN。其中CrossAttention在T2I任务中用于与文本信息交互,FFN起到特征映射的作用,因此与服装、人物特征交互最相关的便是SelfAttention。

理论上确定了需要训练的模块后,在实验上,CatVTON文中还进行了消融,发现对UNet、TransformerBlock和SelfAttention分别进行解锁训练,其可视化结果并没有明显的差异,同时在指标上也十分接近,验证了“SelfAttention是将预训练扩散模型迁移到TryOn任务的关键模块”的假设。

最后通过理论和实验锁定的SelfAttention部分,只有49.57M参数,仅占总参数量5.71%的部分,对其进行微调,就可以实现逼真的试穿效果,在上一节表格中可以看到,相较于其他方法,CatVTON将可训练参数量减少了10倍以上。

最后总结,CatVTON重新思考和设计了基于扩散模型的虚拟试穿框架,将多任务、多品类的虚拟试衣集成到同一模型中,以轻量化的框架和参数高效的训练策略实现了SOTA的试穿效果,降低了模型的训练、推理计算需求,更有利于虚拟试衣模型走向落地与应用。

以上内容为资讯信息快照,由td.fyun.cc爬虫进行采集并收录,本站未对信息做任何修改,信息内容不代表本站立场。

快照生成时间:2024-08-01 12:45:01

本站信息快照查询为非营利公共服务,如有侵权请联系我们进行删除。

信息原文地址: